[VLA 2.0 Media Experience Day] Kernbotschaft

Kernpunkte

| Kernbotschaft: Von Nerd-Exklusiv zu Alltagsnotwendigkeit – XPENG VLA 2.0 ist das intelligente Fahrerlebnis für die ganze Familie. |

|---|

| Wir machen intelligentes Fahren so einfach wie den Aufzug: Drücken Sie einen Knopf und kommen Sie entspannt am Ziel an. |

| - XPENG VLA 2.0 – Das Grundmodell für die physische Welt, das der ganzen Familie Sicherheit schenkt. |

| - Sanft und sicher: Vorausschauende Wahrnehmung, ausgewogene Geschwindigkeitssteuerung, höfliches Ausweichen und präzise Abstandsregelung. |

| - Vollständige Szenario-Abdeckung: Funktioniert makellos Tag und Nacht in allen Umgebungen, einschließlich enger Gassen, Wohnkomplexe, Anfahren aus dem Stand und Navigation in Parkhäusern. |

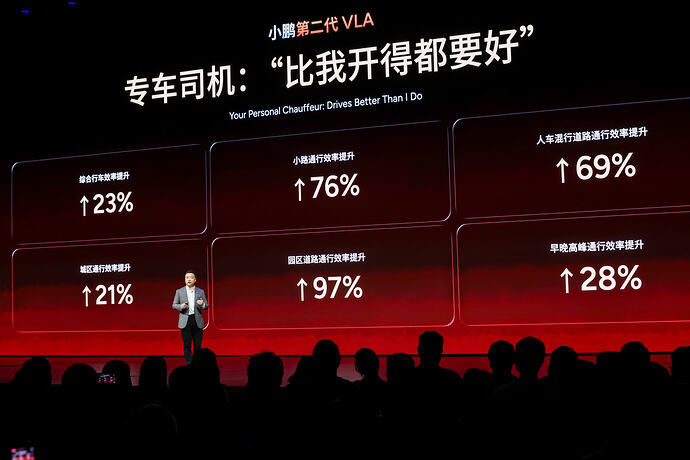

| - Hohe Effizienz: Bietet Chauffeur-Niveau mit ruhiger Bewältigung komplexer Szenarien und schneller Durchfahrt. |

| - Neudefinition des Modell-Paradigmas Richtung L4-Endspiel: |

| - XPENG VLA 2.0 hat öffentliche Straßen-Tests in China begonnen, globale Tests starten bald, weltweiter Ausrollplan für 2027. |

Über VLA 2.0

1. Was ist VLA?

VLA steht für Vision-Language-Action-Modell, ein multimodales KI-Modell, das visuelle Wahrnehmung, natürliches Sprachverständnis und Aktionssteuerung in einem einzigen, vereinheitlichten Großmodell integriert.

- Einfach gesagt: Die Eingabe besteht aus visuellen Informationen, die Ausgabe aus Aktionsbefehlen.

- In Bezug auf Vielseitigkeit ist es für eine breite Palette physischer Endgeräte einsetzbar, einschließlich Roboter, Robotaxis und Flugzeuge.

2. Unterschiede, Upgrades und Features von VLA 2.0 im Vergleich zur Branche?

XPENG VLA 2.0 bringt architektonische Innovationen, indem es die intermediäre „L“-Schicht (Sprachrepräsentation) entfernt. Es verarbeitet visuelle Signale aus der physischen Welt direkt zu Aktionen, was schnellere Verständnis- und Befehlsausgabe ermöglicht.

- Positionierung: VLA 2.0 ist das erste intelligente Fahrmodell in China mit L4-Potenzial. Es ist das einzige in China, das mit Tesla FSD mithalten kann.

- Entwicklung: XPENGs L4-Robotaxi wird mit dem VLA 2.0-Modell ausgestattet. L4-Autofahren ist der erste Schritt zur Embodied AI, bei der dieselbe Modellarchitektur universell auf verschiedenen Hardware-Plattformen einsetzbar ist.

- Schlüssel-Highlights: Statt komplexer technischer Prinzipien drehen sich die Kernvorteile um vier Säulen: Reduzierter Verlust, Schnellere Reaktion, Menschliches Verhalten und Intelligenz-Emergenz.

3. Wie unterscheidet sich XPENG VLA 2.0 von anderen intelligenten Fahrsystemen und übertrifft sie?

Im Vergleich zu anderen Lösungen:

- Verbesserte Nutzererfahrung: XPENG VLA 2.0 ist intuitiver und schenkt allen Nutzern – von Neulingen bis Profis, aller Altersgruppen und Geschlechter – Ruhe. Es ist wirklich eine universelle Software für jedermann.

- Überlegene Vielseitigkeit: Auf menschlichen Prinzipien aufgebaut, arbeitet es nach dem „What you see is what you get“-Prinzip. Das führt zu starker Generalisierungsfähigkeit, sodass es global in allen Szenarien einsetzbar ist.

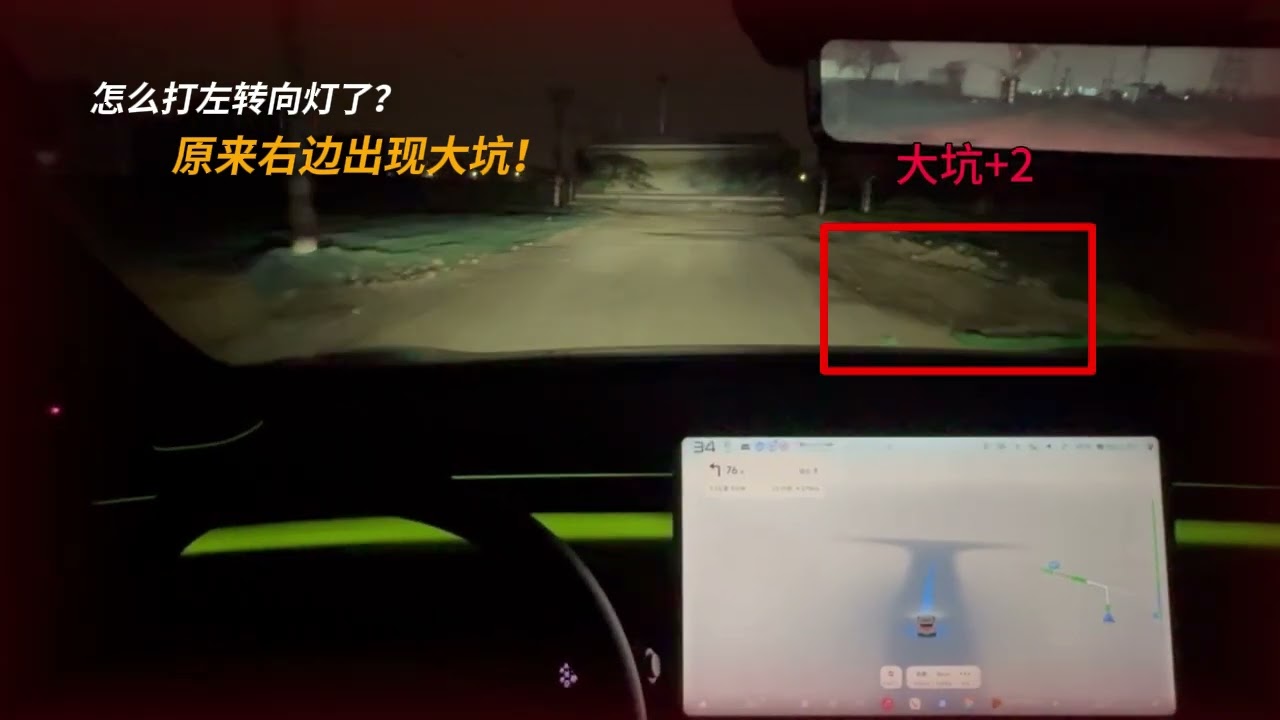

- Höhere Intelligenz: Es reagiert deutlich intelligenter in extremen oder seltenen Situationen. Beispiele: Interpretation von Handzeichen der Verkehrspolizei, Herantasten beim Ampel-Countdown-Ende oder kurzfristige Übernahme in Notfällen. Wenn der Fahrer auf der Autobahn handlungsunfähig wird, erkennt die Innenraumkamera den Zustand und lenkt das Fahrzeug autonom sicher an den Rand.

4. Highlights des Smart Cockpits

- Das SR (Surround Reality)-System ist nahtlos mit XPENG VLA 2.0 verbunden, um die Fahrumgebung in Echtzeit zu erkennen. Diese Infos werden auf dem Display synchronisiert, um Fahrtrajektorien zu generieren und Fahrer sowie Passagieren eine klare, intuitive Übersicht zu bieten.

- Das System erkennt und zeigt detaillierte Echtzeit-Infos an, inklusive Fußgänger, E-Scooter, Blinker umliegender Fahrzeuge und Ampel-Countdowns.

- Fahrer und Passagiere an verschiedenen Sitzplätzen können mit dem AI-Assistenten sprechen, um Befehle zu geben – z. B. Echtzeit-Navi-Updates oder präzise Anpassung der Klima-Düsenrichtungen.

- Die Innenraum-AI-Kamera analysiert Bewegungen und Zustand des Fahrers und gibt proaktive Warnungen: Müdigkeitserkennung, Mahnung, auf die Straße zu schauen, oder Verbote der Handy-Nutzung am Steuer.

Und hier ein erstes Video, wie der Assistent bei uns funktioniert (gerne liken ![]() )

)![]()